-

Nvidia Rubin CPX: Spezialbeschleuniger für KI-Inferencing kommt Ende 2026

Nvidia will Ende 2026 einen speziellen Beschleunigerchip auf den Markt bringen, den Rubin CPX. Er soll speziell KI-Anwendungen mit enormen Context-Anforderungen (siehe unten) beschleunigen, denen wiederum eine besonders hohe Profitabilität unterstellt wird. Darunter sind KIs, die Programmcode liefern oder KI-Filme aus dem Nichts erstellen. Rubin CPX soll die spezifischen Flaschenhälse bei der Verarbeitung solcher KI-Modelle gezielt angehen.

Der Chip gehört zu Nvidias 2026 kommender Vera-Rubin-Generation von Rechenzentrumsbeschleunigern, die bereits ihren Tape-Out hinter sich hat. Er ist entweder direkt im Rackeinschub integriert oder als Zusatz-Beschleuniger in separaten Einschüben zu bekommen.

Mixture-of-Experts und Context-Länge

Die aktuell angesagten KI-Modelle wie DeepSeek R1, Llama4 Maverick, gpt-ossm, Qwen3 oder auch Kimi K2 verwenden eine Technik, die man Mixture-of-Experts nennt. Dabei kommen verschieden spezialisierte neuronale Netze (die Experts) für unterschiedliche Anfragen(teile) zum Einsatz. Das wiederum führt bei den einzelnen Experten zu geringeren Anforderungen an Speicher und Rechenleistung.

Der Trick ist, die optimale Mixtur von Experten für jede Anfrage hinzubekommen; die Verteilung der Anfragen auf die Experten wird entscheidend. Gerade in Verbindung mit Reasoning müssen die einzelnen Experten miteinander kommunizieren und das MoE-Modell als Ganzes wird aufwendiger.

Zugleich werden die Antworten von KI-Anwendungen um Größenordnungen komplexer, etwa durch die Ausgabe ganzer Programmcode-Sequenzen oder künstlich erzeugter Filme. Das lässt die Anzahl der Token, die ständig berücksichtigt werden müssen, exponentiell ansteigen. Ein Token ist dabei die kleinste Informationseinheit, die innerhalb einer KI eine numerische ID zugewiesen bekommt, um die Berechnungen zu vereinfachen. Ein Token kann Informationen von einem Buchstaben bis hin zu kurzen Phrasen repräsentieren. Schätzungen setzen ein englisches Wort im Durchschnitt mit 1,5 Token gleich.

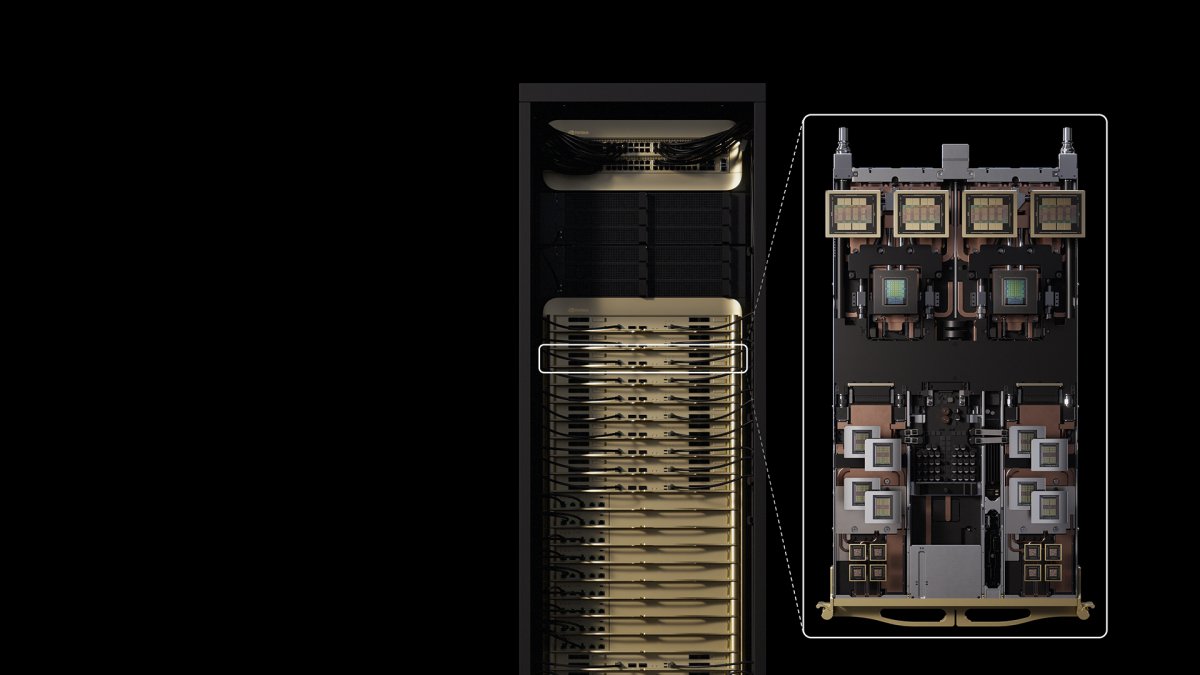

Nvidias Vera Rubin-Beschleuniger in einer künstlerischen Darstellung. Damit ausgerüstete Systeme sollen 2026 in Rechenzentren ankommen.

Damit die Antwort in sich konsistent ist, muss die KI intern noch weitaus mehr Token bei der Gewichtung berücksichtigen als im Antwortfenster ausgegeben werden, das nennt man Context. Chat-GPT 3.5 hatte anfangs ein Context-Window von 4096 Token. GPT-4o ist schon bei 128.000 Token, Google Gemini 1.5 Pro bei 2 Millionen Token.

Disaggregated Serving

Ein dadurch entstandener Optimierungsansatz ist das entkoppelte Beantworten der Anfragen (disaggregated serving). Dabei werden Context- und Prefill-Stufen bei der Beantwortung einer Anfrage verschiedenen Beschleunigern zugewiesen. Nvidia nutzt das bereits mit aktuellen GB200-Blackwell-Systemen. So arbeiten etwa in den optimierten Einreichungen zu den KI-Benchmarks der MLCommons MLPerf Inference v5.1 von den 72 Blackwell-GPUs eines NVL72-Racks 56 GPUs nur am Context und nur die restlichen 16 erzeugen die Inhalte. Diese Optimierung bringt geschätzt anhand eines ungenau beschrifteten Diagramms einen Performance-Sprung von 40 bis 45 Prozent auf Blackwell.

Nvidia macht sich dabei noch eine Eigenschaft dieser LLMs zunutze: Sie kommen mit entsprechendem Feintuning auch mit recht niedriger Rechengenauigkeit aus, sodass das hauseigene, 4-bittige Floating-Point-Format NVFP4 mit blockweise geteiltem Exponenten für die erforderliche Antwortgenauigkeit bei MLPerf Inference ausreicht.

Von Blackwell zu Rubin (CPX)

Bereits Blackwell Ultra (GB300) hat Nvidia auf maximalen Durchsatz bei diesem Format optimiert. Dafür haben die Ingenieure die Exponent-2-Funktion aufgebohrt, die im Attention-Layer aller KI-Modelle mit Transformer-Technik eine große Rolle spielt. Da diese außerhalb der auf KI-Durchsatz spezialisierten Tensorkerne in den SFU-Einheiten (Special Function Units) laufen, sind sie in Blackwell bereits zum Flaschenhals geworden, denn die EX2-Leistung gegenüber Hopper ist kaum gewachsen. Blackwell Ultra verdoppelt den EX2-Durchsatz gegenüber Blackwell von 5 auf 10,7 Billionen Exponential-Berechnungen pro Sekunde.

Ein NVL72-Schrank GB300 schafft rund 1,1 ExaFLOPS in NVFP4, Rubin NVL144 wird von Nvidia auf 3,6 EFlops projektiert und ein Rubin-CPX-Rack auf satte 8 EFlops.

Ein Rubin CPX soll Ende 2026 gegenüber dem heutigen GB300 den dreifachen Exponential-Durchsatz von 30 PFlops NVFP4 schaffen. Da die Context-Phase weniger schnellen RAM benötigt und hauptsächlich von den Berechnungen limitiert wird, setzt Nvidia bei Rubin CPX auf 128 GByte GDDR7-Speicher.

(csp)

Dieser Link ist leider nicht mehr gültig.

Links zu verschenkten Artikeln werden ungültig,

wenn diese älter als 7 Tage sind oder zu oft aufgerufen wurden.

Sie benötigen ein heise+ Paket, um diesen Artikel zu lesen. Jetzt eine Woche unverbindlich testen – ohne Verpflichtung!