Yann LeCun lascia Meta. Dopo 12 anni come chief AI scientist, il vincitore del Premio Turing e co-inventore del deep learning moderno abbandona l’azienda di Mark Zuckerberg per fondare una startup. Il motivo è filosofico: LeCun è convinto che i large language models (LLM) come ChatGPT, Gemini e lo stesso Llama di Meta siano un vicolo cieco nella corsa verso l’intelligenza artificiale generale.

La sua nuova azienda si concentrerà sui “world models”, sistemi che imparano guardando video e dati spaziali invece di divorare testo. Il “grande strappo” si può riassumere nel fatto che Meta investe 600 miliardi in LLM e lui pensa sia tempo sprecato. E se lo dice uno che ha inventato metà delle tecnologie su cui girano, forse vale la pena ascoltare.

Quando il padrino dell’IA diventa il dissidente

La storia di Yann LeCun è quella di uno che ha sempre avuto ragione troppo presto. Anni ’80, Parigi: nessun professore vuole seguire la sua tesi sul machine learning perché “non è un argomento serio”. Anni ’90, AT&T Bell Labs: sviluppa le reti neurali convoluzionali che oggi alimentano il riconoscimento facciale di miliardo di smartphone. 2018: vince il Premio Turing insieme a Geoffrey Hinton e Yoshua Bengio, i tre “padrini del deep learning”.

Oggi, nel 2025, Yann LeCun dice che tutti stanno sbagliando. ChatGPT? “Meno intelligente di un gatto.” GPT-5? “Non arriverà mai al ragionamento umano.” L’idea di scalare gli LLM fino alla superintelligenza? “Una stronzata”, nelle sue parole. Un po’ come quando Galileo disse alla Chiesa che era la Terra a girare intorno al sole, solo che stavolta la Chiesa è Silicon Valley e ha appena investito centinaia di miliardi nell’idea che la Terra stia ferma. E che, sempre stavolta, non sappiamo esattamente cosa giri intorno a cos’altro.

Meta sceglie il prodotto, Yann LeCun sceglie la scienza

Il divorzio era nell’aria da mesi. A giugno 2025, Meta ha investito 14,3 miliardi di dollari in Scale AI, assumendo il suo CEO ventottenne Alexandr Wang per guidare la nuova divisione “Meta Superintelligence Labs”. Risultato pratico: Yann LeCun, 65 anni, tre lauree e un Premio Turing, ora è di fatto alle sue dipendenze: risponde a Wang.

Come riportato da TechCrunch, la riorganizzazione ha spostato il laboratorio FAIR (Fundamental AI Research), fondato da Yann LeCun nel 2013, da un centro di ricerca a lungo termine a un centro di sviluppo di prodotti commerciali.

Non è tutto: A ottobre 2025, Meta ha tagliato circa 600 posizioni nella divisione AI. Più della metà degli autori del paper originale di Llama ha lasciato l’azienda nei mesi successivi alla pubblicazione.

Il modello Llama 4 non ha raggiunto le aspettative interne e resta indietro rispetto a OpenAI e Google. Per questo la fretta di Zuckerberg di competere con ChatGPT ha trasformato FAIR da laboratorio di ricerca di eccellenza a fabbrica di prodotti.

LeCun non ha mai nascosto il suo scetticismo. “Prima di ‘capire urgentemente come controllare sistemi AI più intelligenti di noi’, dovremmo avere almeno l’inizio di un’idea di come progettare un sistema più intelligente di un gatto domestico”, ha scritto su X.

I chatbot, dice, predicono la prossima parola in una sequenza. Non ragionano, non pianificano, non capiscono causa ed effetto. Memorizzano soltanto dei percorsi. Un gatto che salta su un tavolo calcola traiettorie, gravità, resistenza dell’aria. ChatGPT no. Qual è la prossima strada, dunque?

World models: l’IA che impara guardando

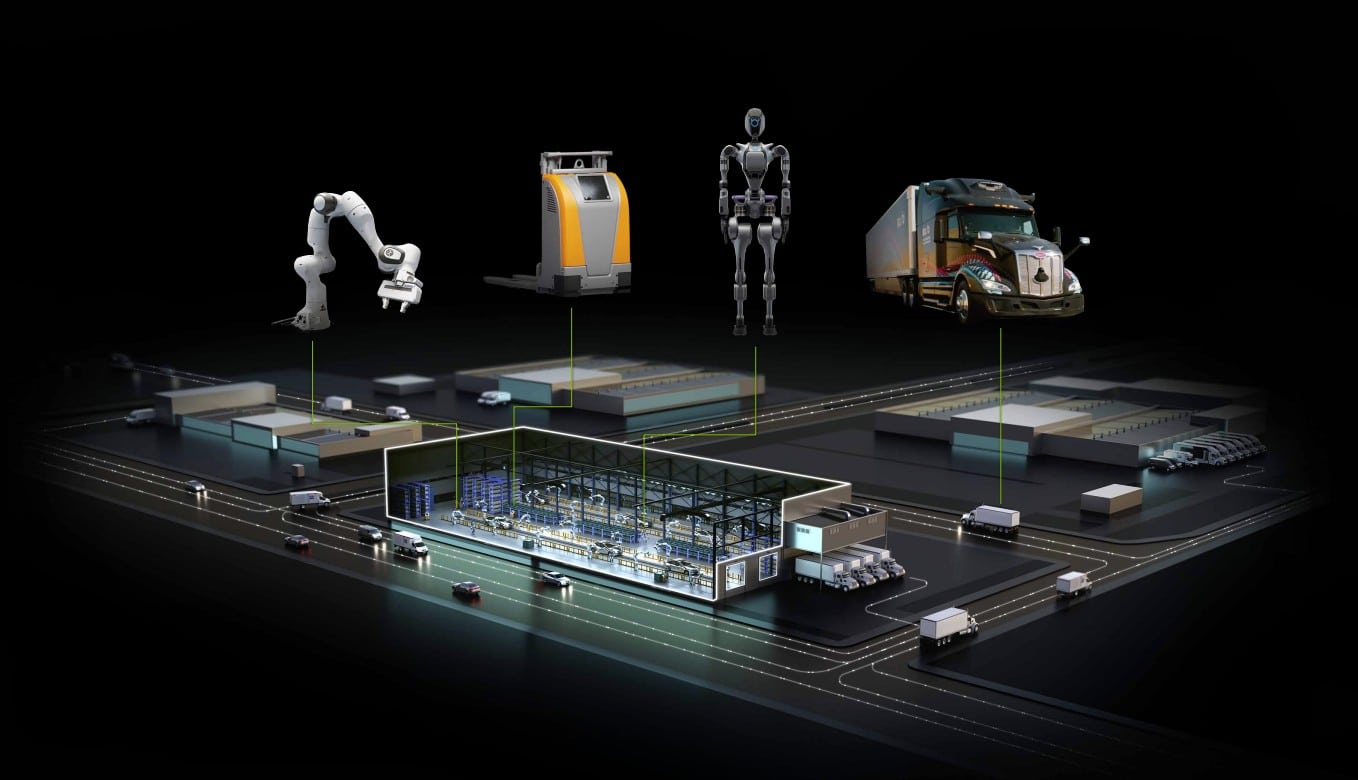

La startup di Yann LeCun si concentrerà sui “world models”, architetture che apprendono dalla realtà fisica. L’idea, descritta nel suo paper del 2022 “A Path Towards Autonomous Machine Intelligence”, è semplice: invece di nutrire l’AI con miliardi di parole, la si nutre con video e dati spaziali. Come fa un bambino: guarda, tocca, sbaglia, impara. Il sistema costruisce una rappresentazione interna del mondo fisico, comprende causa-effetto, anticipa scenari.

Google DeepMind lavora su SIMA 2, agente che ragiona in ambienti 3D virtuali. World Labs di Fei-Fei Li ha raccolto 230 milioni per progetti simili. La differenza? LeCun ha quarant’anni di esperienza nel far funzionare idee che sembravano impossibili. Le sue reti convoluzionali degli anni ’90 elaboravano il 10-20% degli assegni bancari negli Stati Uniti quando tutti dicevano che le reti neurali erano morte.

I world models imparano osservando il mondo fisico, non leggendo testo. Un po’ come fa un gatto prima di saltare: calcola, prevede, agisce.Il profeta inascoltato

C’è un’ironia sottile nella situazione. Yann LeCun ha costruito le fondamenta tecnologiche su cui girano ChatGPT, Gemini, Claude e tutti gli altri. Il transformer, l’architettura dietro gli LLM, usa componenti che LeCun ha contribuito a sviluppare. Eppure ora dice: fermatevi, state scalando la cosa sbagliata. È come se l’inventore del motore a scoppio dicesse che le auto elettriche sono il futuro. Tecnicamente ha costruito l’industria, filosoficamente vuole cambiarla.

Il mercato non sembra preoccupato. Le azioni Meta sono calate dell’1,5% alla notizia, secondo Dataconomy, ma niente panico. Zuckerberg ha già formato un team d’élite, TBD Lab, con pacchetti da 100 milioni di dollari per attrarre talenti da OpenAI e Anthropic. La strategia è chiara: prodotti veloci, competizione agguerrita, risultati trimestrali. La scienza può aspettare.

L’idea di Mark e di altri è fare soldi ora, spingendo su sistemi che non raggiungeranno la super intelligenza (ma far credere che lo faranno è una componente importante di marketing che serve a venderli). Dopotutto sono già pronti e hanno una loro utilità. Con quei soldi, poi, magari alimentare lo sviluppo di modelli diversi che puntino al “bersaglio grosso” dell’AGI. Magari attraverso l’addestramento fisico dei robot. Sarà sbagliato, ma capisco la logica: certo, è profitto che vince sulla ricerca. Ma vi stupisce che sia così?

LeCun invece pensa in decenni. “Questi sistemi potrebbero richiedere dieci anni per maturare”, ha detto parlando dei world models. Dieci anni sono un’eternità in Silicon Valley, dove la media di attenzione è tre trimestri. Ma LeCun ha aspettato quarant’anni prima che le reti neurali diventassero mainstream. Sa aspettare.

La scommessa del dissidente

Secondo fonti citate dal Financial Times, LeCun è già in discussioni preliminari con investitori. Il pacchetto iniziale di finanziamenti potrebbe superare i 100 milioni di dollari, cifra record per una startup in questa fase. Il motivo è ovvio: se sei Yann LeCun e dici “gli LLM sono sbagliati, io costruirò l’alternativa”, i soldi arrivano. La reputazione conta. Anche quando vai controcorrente? Soprattutto quando vai controcorrente.

Il timing è curioso. Mentre LeCun se ne va, Meta annuncia investimenti fino a 118 miliardi di dollari per il 2025 in infrastrutture AI e data center. L’azienda punta tutto su Llama e sulla “superintelligenza”. LeCun punta su sistemi che imparano come bambini, non come pappagalli statistici.

Chi ha ragione? Tra dieci anni lo sapremo. O forse tra quaranta, come è successo con le reti neurali. Non vi scoraggiate, a volte i tempi della realtà sono diversi da quelli del marketing.

Resta una domanda: se l’uomo che ha inventato metà dell’IA moderna dice che stiamo sbagliando strada, perché nessuno frena? La risposta è semplice. Fermarsi costa. Ripensare costa. Ammettere che miliardi di investimenti potrebbero inseguire un limite fisico invece che una frontiera costa troppo. Più facile pensare che LeCun, stavolta, abbia torto. Più facile continuare a scalare, e sperare che GPT-7, o 8, o 9 siano diversi, che prima o poi emerga l’intelligenza. Magari succede davvero, e succede in 3 anni come tanti dicono.

Oppure ha ragione Yann LeCun. Di nuovo. Come negli anni ’80, quando nessuno credeva nelle reti neurali. Come negli anni ’90, quando le convoluzionali sembravano troppo complesse. Come nel 2025, quando dice che l’intelligenza non viene dal testo ma dal mondo fisico.

La storia gli ha dato ragione troppe volte per ignorarlo.