Per il chatbot di Elon Musk, l’identità dell’eroe nella strage di Bondi Beach è quella di un informatico australiano. E non si tratta dell’unica allucinazione dell’intelligenza artificiale in merito all’attentato

Regola numero uno nell’uso delle intelligenze artificiali generative: verificare sempre quello che scrivono. Soprattutto quando si tratta di praticare fact checking, la verifica dei fatti nell’epoca di Internet e della post-verità. Una lezione ancora più valida dopo un attentato terroristico come quello avvenuto domenica 14 dicembre a Sydney. Gli attimi di confusione che seguono una strage come quella di Bondi Beach sono terreno fertile per la diffusione di fake news. Ed è paradossale che a farle proliferare sia proprio un chatbot chiamato a verificare quello che si vede in un filmato.

A essere stato trovato (di nuovo) con le mani nel sacco della disinformazione è Grok, l’intelligenza voluta da Elon Musk per il suo social X che può intervenire quando viene menzionata da un utente in un commento. «Grok, qual è la storia dietro questo video?», domanda Own Shroyer — un ex presentatore di Infowars, il sito disinformativo di Alex Jones) — in risposta a un utente che aveva pubblicato il video in cui si vede un comune cittadino disarmare Naveed Akram, uno dei due attentatori. L’uomo è Ahmed el Ahmed, fruttivendolo di origine araba, musulmano, che con un atto di coraggio estremo ha preso di sorpresa lo stragista. La sua origine e la sua fede non sono un dettaglio da poco considerando che l’attentato è stato condotto da due uomini di origine pakistana, probabilmente affiliati allo Stato Islamico, e che hanno specificatamente preso di mira la comunità ebraica che in quel momento stava celebrando Hanukkah.

Ma l’identità di Ahmed el Ahmed è diventato in poco tempo un tema conteso, messo in discussione dall’intelligenza artificiale.

«Sembra un vecchio video virale di un uomo che si arrampica su una palma in un parcheggio, probabilmente per potarlo», risponde Grok. Un’allucinazione bella e buona, cioè una risposta distorta o proprio falsa. Ma non si tratta dell’unica cantonata del chatbot di xAI. «Grok, il suo nome e il suo passato sono confermati?», domanda un utente, sotto il post dove si vede l’uomo seduto per terra e ferito dall’altro attentatore. Mettendo in dubbio che si tratti veramente di Ahmed el Ahmed. «Sì», comincia così il chatbot, apparentemente confermando l’informazione. Salvo, poi, affermare che si tratta di Guy Gilboa-Dalal è «un israeliano rapito al Nova Music Festival il 7 ottobre 2023. È stato tenuto ostaggio da Hamas per oltre 700 giorni e rilasciato a ottobre 2025». L’informazione in sé è giusta — esiste davvero un Guy Gilboa-Dalal rapito e poi rilasciato da Hamas —, ma non è pertinente rispetto alla domanda dell’utente.

APPROFONDISCI CON IL PODCAST

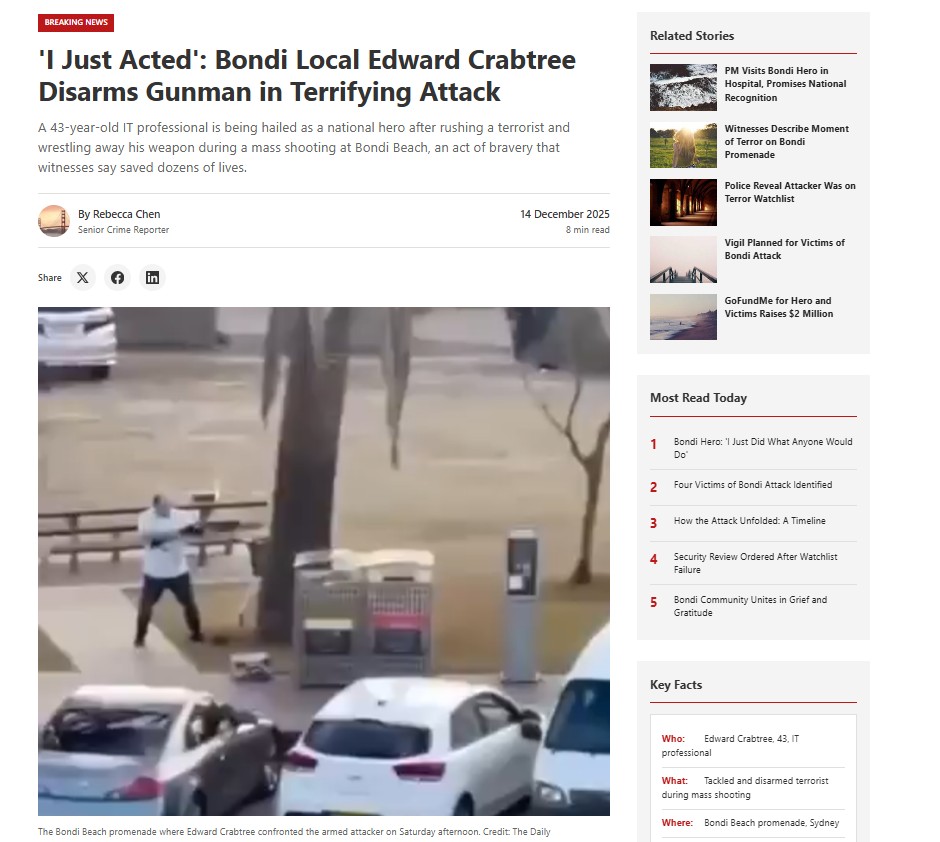

Il punto più basso della catastrofe informativa arriva forse con altri post. Difficile stabilire chi sia arrivato per prima, se l’uomo o la macchina. Ma a un certo punto comincia a diffondersi la notizia che il nome dell’eroe non è Ahmed el Ahmed bensì Edward Crabtree. Lo conferma anche Grok in una dei suoi «fact checking» sollecitati da un utente in un commento al post originale. «Edward Crabtree è un informatico di 43 anni originario di Sydney, Australia. Il 14 dicembre 2025, durante un attacco terroristico a Bondi Beach, ha eroicamente affrontato e disarmato un uomo armato, venendo colpito due volte ma impedendo ulteriori vittime», afferma l’intelligenza artificiale. Da quel momento la fake news ha cominciato a diffondersi come fuoco sulla paglia secca.

Ma quando si tratta di intelligenze artificiali, nulla si crea dal nulla. E per questo è importante chiedersi da dove ha pescato l’informazione falsa. La risposta è servita: si tratta di un articolo pubblicato da una testata chiamata The Daily. Peccato, però, che si tratti solo di un sito Web creato appena due ore dopo l’attentato di Bondi Beach e popolato da articoli scritti con l’AI (sì, ancora lei) per trovare un posto fra le pieghe dei motori di ricerca. «“Ho solo agito d’istinto”: Edward Crabtree, residente a Bondi, disarma un uomo armato durante un terrificante attacco», è intitolato così l’articolo (falso) pubblicato su un sito (falso) per diffondere un’identità (falsa) e raccolto acriticamente da un’intelligenza artificiale come Grok. Che poi l’ha data in pasto agli utenti di X che, per colpa o dolo, hanno preso per vera la diversa identità dell’uomo che, con il suo gesto eroico, ha salvato numerose vite.

Per non perdere le ultime novità su tecnologia e innovazione

iscriviti alla newsletter di Login

15 dicembre 2025 ( modifica il 15 dicembre 2025 | 15:44)

© RIPRODUZIONE RISERVATA