Un’inchiesta svedese rivela la forza lavoro «nascosta» che, per addestrare l’AI, guarda e studia i video che registriamo con gli smart glasses. E online spunta l’app che ti avvisa quando uno sconosciuto che li indossa è vicino

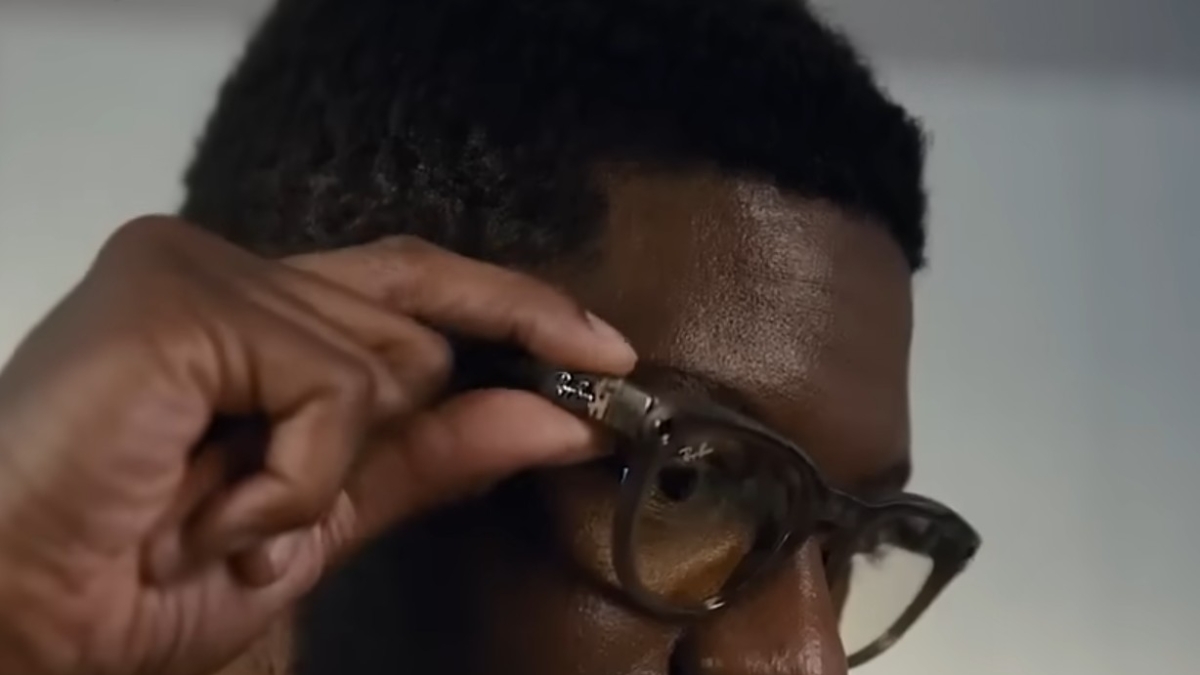

Chi indossa i Ray-Ban Meta lo sa bene: per raccontare la propria quotidianità non c’è più bisogno di usare complicate macchine fotografiche o anche solo di tirare fuori gli smartphone che abbiamo in tasca. La fotocamera e la videocamera ora le portiamo direttamente sul viso. Basta un clic per documentare la bellezza che ci circonda e per condividerla con i propri contatti online, su Facebook o su Instagram. Quello che spesso gli utenti non sanno — o meglio, che dimenticano — è che foto e registrazioni (anche se non condivise sui social) possono essere visualizzate da operatori umani. Dalla condivisione “attiva” a una “passiva”, spesso dimenticata. E così pezzi della nostra vita privata, talvolta sensibili come i dati bancari o persino scene di intimità con il partner, sono scansionati dai dipendenti di aziende appaltatrici che si occupano di etichettare tutti gli elementi che compaiono in delle immagini. Si tratta del lavoro degli annotatori. Che, a una testata svedese, hanno confessato di avere potenzialmente accesso alla vita privata di milioni di persone.

L’inchiesta svedese

«Vediamo di tutto, dai salotti ai corpi nudi. Meta ha questo tipo di contenuti nei suoi database. Le persone possono registrarsi nel modo sbagliato e non sapere nemmeno cosa stanno registrando. Sono persone reali, come te e me». Queste sono le parole di un anonimo annotatore kenyota intervistato dal quotidiano svedese Svenska Dagbladet. Anonimo perché se l’azienda per cui lavora, Sama, dovesse scoprire che ha raccontato il proprio lavoro a dei giornalisti, sarebbe licenziato. Per lavorare in quel settore si firmano pesanti accordi di riservatezza. E negli uffici in cui lavora non si possono portare neanche gli smartphone proprio per non rischiare che i contenuti sensibili che vedono ogni giorno finiscano fuori da quelle quattro pareti di Nairobi.

Il punto è che quelle immagini non sono illegalmente o indebitamente acquisite e visualizzate dall’azienda in Kenya. È tutto nei termini di servizio di Meta AI, l’intelligenza artificiale che ora è integrata su quasi tutti i prodotti dell’azienda di Mark Zuckerberg. Compresi, appunto, i Ray-Ban Meta. «In alcuni casi, Meta esaminerà le interazioni dell’utente con le AI, compreso il contenuto delle conversazioni o dei messaggi inviati alle AI, e tale esame potrà essere automatizzato o manuale (effettuato da esseri umani)». È proprio in questo angolo polveroso del termini d’uso che finiscono foto e video personali degli utenti, che magari registrano inconsapevolmente quello che vedono gli occhiali smart anche senza rendersi conto che son attivi. E senza sapere per quanto tempo questi contenuti saranno conservati nei database di Meta né chi abbia accesso ai video registrati e dati in pasto all’AI, neanche quelli che sono stati registrati per sbaglio.

L’azienda precisa che i video rimangono sul dispositivo a meno che l’utente non decida di condividerli con l’intelligenza artificiale. «Quando le persone condividono contenuti con Meta AI, possiamo talvolta avvalerci di collaboratori esterni per esaminare questi dati al fine di migliorare l’esperienza delle persone, come molte altre aziende fanno», dichiara un portavoce della compagnia. «Adottiamo misure per filtrare questi dati con l’obiettivo di proteggere la privacy delle persone e contribuire ad impedire che vengano esaminate informazioni identificative».

Un difficile equilibrio fra la possibilità di sfruttare tutte le potenzialità del dispositivo potenziato dall’AI e, dall’altro lato, la sempre più complessa protezione della nostra privacy. In mezzo, c’è l’attenzione e la prudenza degli utenti, che devono sempre stare in guardia quando usano lo strumento senza dimenticarsi cosa può fare. E così video di persone che girano nude in bagno, persone che inquadrano per sbaglio tutte le informazioni della propria carta di credito o vere e proprie scene di sesso potrebbero finire nei sistemi di Meta per essere analizzate dagli operatori umani di Nairobi, che ogni giorno passano al setaccio un grandissimo numero di immagini per annotare manualmente cosa è cosa, evidenziando gli oggetti nell’inquadratura e dandogli un nome, dai vasi di fiori ai segnali stradali, per aiutare l’intelligenza artificiale nel compito di riconoscere il mondo che ci circonda.

«In alcuni video si vede qualcuno che va in bagno o che si spoglia. Non credo che lo sappiano, perché se lo sapessero non registrerebbero», dice uno degli annotatori intervistati. Il punto sta proprio nella (mancata) consapevolezza degli utenti quando si accettano le (lunghissime e complesse) condizioni di servizio che bisogna accettare prima di utilizzare un prodotto digitale. Spesso il dito va subito su «accetta tutto» prima ancora di avere letto le prime righe del contratto per l’uso del servizio. Portando così alla situazione raccontata ai giornalisti svedesi dai dipendenti di Sama.

Il problema si estende ulteriormente se si considera che questo genere di revisione dei contenuti — dal lavoro degli annotatori a quello dei moderatori, che sono costretti anche a revisionare foto e video etichettati dal’AI come potenzialmente violenti — spesso viene appaltato ad aziende esterne che hanno sede in Paesi in via di sviluppo. Una sorta di “colonizzazione del terzo settore” che spinge le professioni sgradite — che per esempio possono lasciare un profondo impatto nella psiche del lavoratore — ai margini.

L’app che ti avvisa quando ci sono dei Ray-Ban Meta vicini

Il tema della riservatezza legato ai Ray-Ban Meta non è una novità. Sin da quando sono arrivati nel mercato, la preoccupazione degli esperti di sicurezza e privacy (ma non solo) è che persone possano essere riprese senza il loro consenso e senza sapere neanche di venire riprese. È vero, esiste una piccola luce sulla montatura che avvisa le persone vicine che gli occhiali smart stanno registrando. Non mancano i “ma”: la luce potrebbe non essere notata in condizioni di forte luce ambientale, con un’occhiata distratta è possibile che ci si renda conto di un piccolo pezzo di nastro adesivo nero messo a coprire la luce oppure, come aveva raccontato la testata tech 404 Media, possono esserci anche utenti che vendono sistemi (illegali) per disabilitare l’accensione del segnale luminoso per appena 60 dollari.

Non solo. La preoccupazione è che la registrazione dei volti possa trasformarsi in identificazione automatica degli sconosciuti che incontriamo per strada. E se fino a poco tempo fa si trattava solo di un esercizio di stile di due giovani studenti di Harvard (lo avevamo raccontato qui), adesso potrebbe diventare realtà: secondo un documento riservato consultato dal New York Times, Meta sarebbe pronta a lanciare la funzionalità «name tag», che tramite un sistema di riconoscimento facciale installato sugli occhiali smart permetterebbe di identificare le persone incrociate per strada tramite le informazioni di Instagram e Facebook.

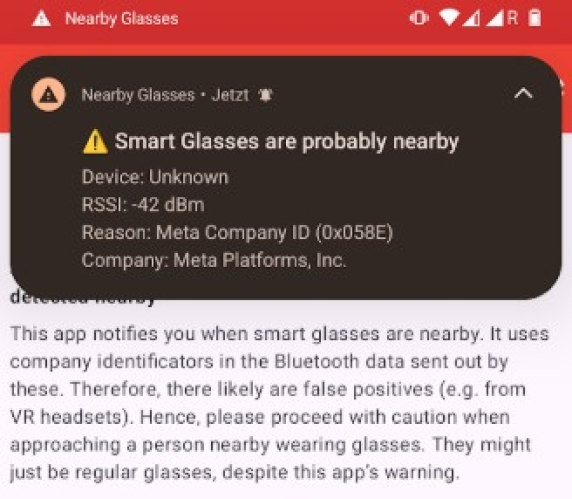

È questo insieme di preoccupazioni che avrebbe spinto uno sviluppatore (per passione), Yves Jeanrenaud, a sviluppare un’app che segnala la presenza nelle vicinanza di un paio di Ray-Ban Meta. Nearby Glasses — questo è il nome dell’app — quando rileva alcuni specifici segnali trasmessi dal Bluetooh degli occhiali, allora manderà sullo smartphone dell’utente una notifica che avvisa l’utente della presenza (in funzione) degli occhiali smart. E se è vero che l’app può generare falsi positivi con altri dispositivi indossabili di Meta — come appunto il visore Quest — bisogna anche considerare che difficilmente in un luogo pubblico troveremo altro che non sia un paio di semplici occhiali.

Per non perdere le ultime novità su tecnologia e innovazione

iscriviti alla newsletter di Login

4 marzo 2026 ( modifica il 5 marzo 2026 | 11:45)

© RIPRODUZIONE RISERVATA