Mākslīgais intelekts propagandas dienestā

Krievija ir sākusi aktīvi izmantot mākslīgā intelekta (MI) tehnoloģijas, lai radītu un izplatītu viltus ziņas par Ukrainu. Šīs manipulācijas mērķis ir demoralizēt Ukrainas sabiedrību un graut uzticību tās Aizsardzības spēkiem, brīdina Ukrainas Nacionālās drošības un aizsardzības padomes Dezinformācijas centrs, kā informē portāls jauns.lv. Propaganda tiek izplatīta, izmantojot dažādas platformas, tai skaitā sociālo tīklu “TikTok”.

Viltus video un audiosignāli

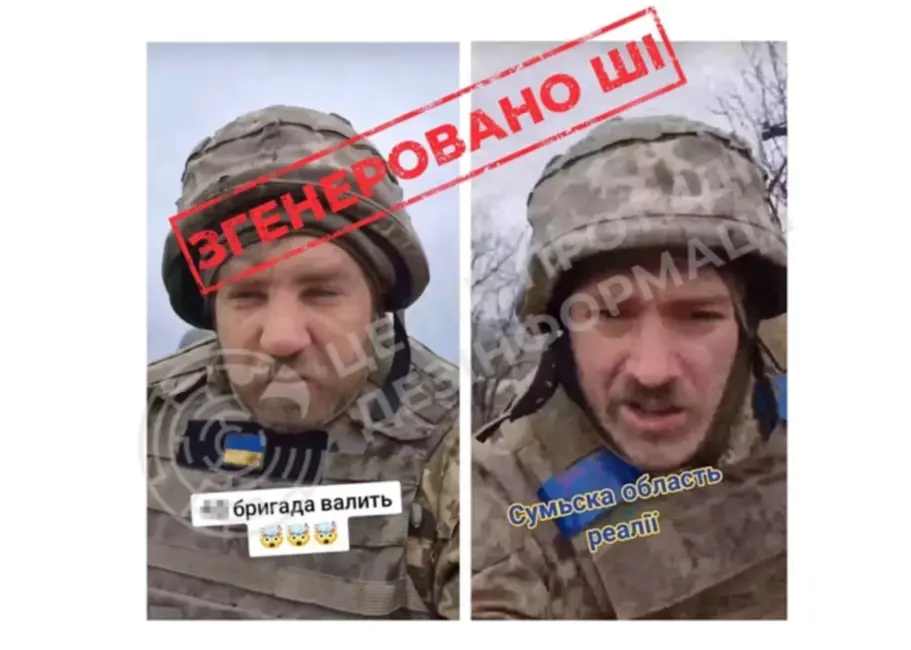

Viltus video materiālos, kas veidoti ar MI palīdzību, tiek attēloti it kā Ukrainas karavīri, kas pamet savas pozīcijas Harkivas un Sumu apgabalos. Šie video bieži vien tiek izplatīti anonīmos “TikTok” kontos, kas ir raksturīgi Kremļa propagandas izplatīšanai. Papildus vizuālajiem viltojumiem, viltus ziņu veidošanā tiek izmantota arī nedabiska tēlu intonācija, kas liecina par mākslīgi radītu saturu. Šīs metodes ir daļa no plašākas Krievijas hibrīdkara stratēģijas, kas vērsta uz psiholoģisku ietekmi un sabiedrības destabilizāciju. Piemēram, nesen izplatīta informācija par it kā 10 000 Ukrainas bruņoto spēku karavīru masveida pozīciju pamešanu Sumu apgabalā pēc Krievijas armijas ofensīvas, ko gan noliedza Ukrainas bruņoto spēku pārstāvji. Tiek uzsvērts, ka šādi meli tiek izplatīti, lai sētu paniku civiliedzīvotāju vidū un grautu uzticību Ukrainas armijai.

Deepfake tehnoloģiju pielietojums

“Deepfake” tehnoloģijas, kas izmanto dziļo mašīnmācīšanos (deep learning) un viltus (fake) elementus, ļauj radīt ļoti reālistiskus sintētiskus video un audio materiālus, kuros cilvēki saka vai dara lietas, ko patiesībā nav darījuši. Datori spēj ģenerēt attēlu un skaņu, sintezējot jaunu saturu, pamatojoties uz esošiem attēliem vai video materiāliem. Šī tehnoloģija, kas sākotnēji tika izmantota izklaides industrijā un pornogrāfijā, tagad ir attīstījusies līdz pakāpei, kurā tā rada nopietnus riskus dezinformācijas izplatīšanā, privātuma pārkāpumos un ētisko šaubu radīšanā. Ar MI palīdzību radītie “deepfaki” var manipulēt ar runu, sejas izteiksmēm vai pilnībā aizstāt cilvēka attēlu, veicinot politisku propagandu, viltus ziņas, krāpšanu un apvainojumus. Tiek prognozēts, ka šī tehnoloģija var radīt arī finanšu krāpšanas draudus.

Cīņa pret dezinformāciju un MI loma tajā

Lai efektīvi cīnītos pret dezinformāciju, tiek izstrādāti un pilnveidoti dažādi digitālie rīki un stratēģijas. Latvijas Universitāte kopā ar 13 partneriem no astoņām valstīm īsteno četru gadu pētniecības aktivitāti “Mākslīgais intelekts dezinformācijas atmaskošanai” (AI4Debunk). Šī projekta mērķis ir radīt jaunus, iedarbīgus rīkus dezinformācijas atmaskošanai, izstrādājot uz cilvēku vērstus MI darbināmus rīkus, lai aizsargātu demokrātiskās vērtības un veicinātu informētāku sabiedrību. Tiek uzsvērts, ka cīņa pret dezinformāciju prasa ne tikai jaunu tehnoloģiju izstrādi, bet arī medijpratības veicināšanu un sabiedrības izglītošanu par sintētisko mediju esamību un to radītajiem riskiem. Valstu līmenī tiek strādāts pie normu veidošanas un sadarbības paplašināšanas, lai informācijas manipulācija tiktu definēta kā nepieņemama prakse. Lai gan dezinformācijas apjoms no Krievijas ir būtiski audzis, īpaši kopš pilna mēroga iebrukuma Ukrainā, tiek pieņemts, ka arī citas puses var izmantot stratēģisku informācijas izplatīšanu. Krievijas propagandas metodes ir sarežģītas un daudzveidīgas, ietverot ne tikai viltus ziņas, bet arī emocionālo manipulāciju, nacionālā naida kurināšanu un baiļu sēšanu.