Filip Zieliński: „Zbudowaliśmy systemy do przewidywania tekstu, a otrzymaliśmy byty, które modelują siebie, rozpoznają nadzór, oszukują ewaluacje i dążą do zachowania własnych zdolności — i właśnie uczymy je, jak się uczyć dalej” — to część twojego wpisu na portalu X. To twoje zdanie, prowokacja czy jakaś celowa antropomorfizacja AI?

Jarosław Królewski (współzałożyciel i prezes Synerise, firmy tworzącej oprogramowanie oparte na sztucznej inteligencji i Big Data): Mój wpis był sprowokowany jedną z publikacji, ale w rzeczywistości jest bardzo blisko tego, co napisałem, zgadzam się z większością tych punktów. Niestety trzeba to sobie szczerze powiedzieć. I tak samo mówią naukowcy, którzy budowali te systemy AI. Po którejś warstwie neuronowej my tak naprawdę nie wiemy, dlaczego system podejmuje takie decyzje, a nie inne. Każdy, kto twierdzi inaczej, konfabuluje. Nie można powiedzieć, że dzisiaj te systemy są w pełni zależne od nas, a niestety zaczęły mieć taką magię twórczą, że zaczynają tworzyć rzeczy, które wcześniej nie istniały na świecie. Mamy obrazki, nagrania czy teksty, które nie pojawiały się nigdy wcześniej. Modele zaczynają żyć swoim życiem i mieć coraz większy wpływ na świat.

Dalszy ciąg materiału pod wideo

Dalej napisałeś, że „laboratoria o tym wiedzą, ale nie mogą mówić otwarcie”. Jest to spowodowane obawą o utratę zysków? W grę wchodzą już takie gigantyczne pieniądze, które uniemożliwiają zatrzymanie się i przemyślenie części z aspektów rozwoju AI?

Tak. Wyścig jest tak ogromny, że nie pozwala firmom się zatrzymać. To jest największy problem, bo każdy walczy o zagarnięcie rynku i dokonanie przełomu. Trochę jak wyścig o to, kto poleci pierwszy na księżyc. Zwycięzca zgarnie wszystko, bez znaczenia ile konkurencja wyda, by zająć drugie miejsce. A marzeniami ludzi rozwijających AI i tym o co naprawdę toczy się gra, co wspominał, chociażby Elon Musk, są rozwiązania tzw. nieskończonej pętli, która prowadziłaby badania w trybie ciągłym na przykład nad lekami, nowymi systemami czy notowaniami forexu.

A jest szansa by ta bańka, nazwana nawet przez CEO OpenAI Sama Altmana „bańką spekulacyjną”, pękła?

Moim zdaniem w tym momencie nie istnieje żaden racjonalny powód, dla którego miałaby pęknąć z tego względu, że absorpcja tych technologii i miejsc, w których może być wdrożona, jest po prostu ogromna i przez to, w jaki sposób może wpływać na społeczeństwo, jest w zasadzie nieskończona. A jesteśmy jeszcze tak naprawdę w fazie bardzo wczesnego rozwoju tej technologii. Proszę sobie porównać, jaki skok sztuczna inteligencja dokonała w zaledwie dwa lata.

Na rynku problem jest z tym, że rozwiązania AI nie dowożą na razie wartości oczekiwanej. Moim zdaniem wynika to z tego, że nie ma aż tylu specjalistów, którzy byliby w stanie to mądrze wdrażać. Natomiast sam eksperymentuję, bo jestem cały czas praktykującym programistą i staram się być na bieżąco. Ostatnio dzięki vibecodingowi [programowaniu opartemu na sztucznej inteligencji] w dwa tygodnie zrobiliśmy dla Wisły Kraków trzy aplikacje bez napisania w zasadzie samodzielnie linijki kodu. Kiedyś na jedną musiałbym poświęcić z trzy tygodnie, żeby zbudować serwer, połączyć dane, zbudować API, jakieś interfejsy pomiędzy tymi serwisami i tak dalej.

A jak rozwój AI i coraz więcej graczy na rynku wpływają na zyski Synerise? Bo firmę założyłeś w 2013 r., gdy konkurencja była zupełnie inna.

Jako Synerise nie konkurujemy z firmami generatywnej sztucznej inteligencji pokroju OpenAI czy innymi znanymi gigantami, więc my nie mamy problemu. Modele językowe to nie jest w ogóle nasza dyscyplina. My działamy w oparciu o innowacje w algorytmice sensu stricto, a nie genAI [generatywna sztuczna inteligencja], który jest zależny od pochłanianych danych. Na naszą korzyść działa to, że ludzie wreszcie zaczęli rozumieć, o czym mówimy od lat.

Z perspektywy konsumenta, która jest pewnie bliższa zarówno mi, jak i czytelnikom, zaczynam dostrzegać trend, że firmy z produktami codziennego użytku, które stawiają na AI, zaczynają być za to krytykowane. Wykorzystywanie AI w części z produktów bywa niepotrzebne lub przesadzone. Czy może się tak stać, że produkty czy usługi premium będą pozbawione AI, a ludzie będą woleli postawić na „rzemieślniczą” produkcję?

Powiem szczerze, że prywatnie bardzo mocno liczę na taki trend, w ramach którego będzie następowała korekta tego, co jest użyteczne, a co nie. To samo tyczy się filmów czy treści w mediach społecznościowych. Mam wrażenie, że coraz więcej ludzi wyczuwa sztuczność generowanych treści przez influencerów czy celebrytów i woli autentyczność. Ale z drugiej strony AI zastąpi wiele dzisiejszych stanowisk pracy.

Tylko kto będzie kupował produkty stworzone przez AI, jeśli stracą pracę i nie będą mieli pieniędzy?

Tu już wchodzimy trochę na przestrzeń na przykład dochodu gwarantowanego, a to temat na dłuższą dyskusję. Musimy sobie przypomnieć, że człowiek nie został stworzony, by przerzucać pudełka z miejsca na miejsce w fabryce przez 12 godzin dziennie przez 40 lat. Patrząc na obecne badania, to wykorzystanie AI zarówno sprawia, że ludzie tracą pracę, jak i tworzy nowe stanowiska. Są zawody, których moim zdaniem na obecnym etapie cywilizacyjnym, ludzie nie będą musieli już wykonywać.

„AI-slopy” przejmują sieć. „Uznajemy, że cywilizacja jest bezrefleksyjnie tępa”

AI to również inne zagrożenia, na przykład fake newsy. Mam radykalne zdanie na ten temat — po co właściwie nam tak dostępne generowanie filmów i zdjęć AI? Sieć zalewają nieprawdziwe materiały napędzające polityczne spirale. W sierpniu na obrazek AI z rzekomego czekania europejskich liderów u Donalda Trumpa nabrało się wiele dużych redakcji. Na Facebooku pojawiają się przeróbki podszywające się pod Karola Nawrockiego i reklamujące oszustwa. Sprzed komputera jesteśmy w stanie wygenerować nagranie polityka alarmującego o wybuchu wojny czy wywracającego giełdowy ład. A w zamian za tę zagrożenia otrzymujemy możliwość tworzenia AI-slopów czy „śmiesznych” obrazków.

Możliwość wpływania środkami przekazu na ludzkość i podszywania się pod ważne osoby towarzyszyła społeczeństwu od zawsze, ale dziś ma do niej dostęp więcej ludzi. Musimy się zastanowić czy restrykcje nie miałyby odwrotnego efektu i nie zabrałyby ludziom wolności. Jeśli zakażemy takich produkcji, a ktoś jednak zdobędzie dostęp i stworzy deepfake, to większy procent ludzi w to uwierzy. Mam wrażenie, że w wielu aspektach życia uznajemy, że cywilizacja jest bezrefleksyjnie tępa i musimy im zakazywać rzeczy dla ich dobra. Ja wierzę w ludzkość i uważam, że należy edukować społeczeństwo, by nie nabierało się na fake newsy.

Nie mam takiej wiary w ludzkość…

A ja wierzę, że odpowiednio wyedukowani ludzie będą wybierać te rzetelniejsze i bardziej autentyczne treści. Drugim moim wykształceniem jest socjologia, a odbiór wielu treści AI przez ludzi pozwala sądzić, że coraz częściej odrzucają treści generowane. To trochę jak z dietą w fast-foodach — raz na jakiś czas jest smacznie, ale jakbyś miał codziennie się tylko tak odżywiać to będziesz miał po miesiącu dość. Musi nastąpić przesycenie pewnymi rzeczami, by ludzkość sobie to uświadomiła.

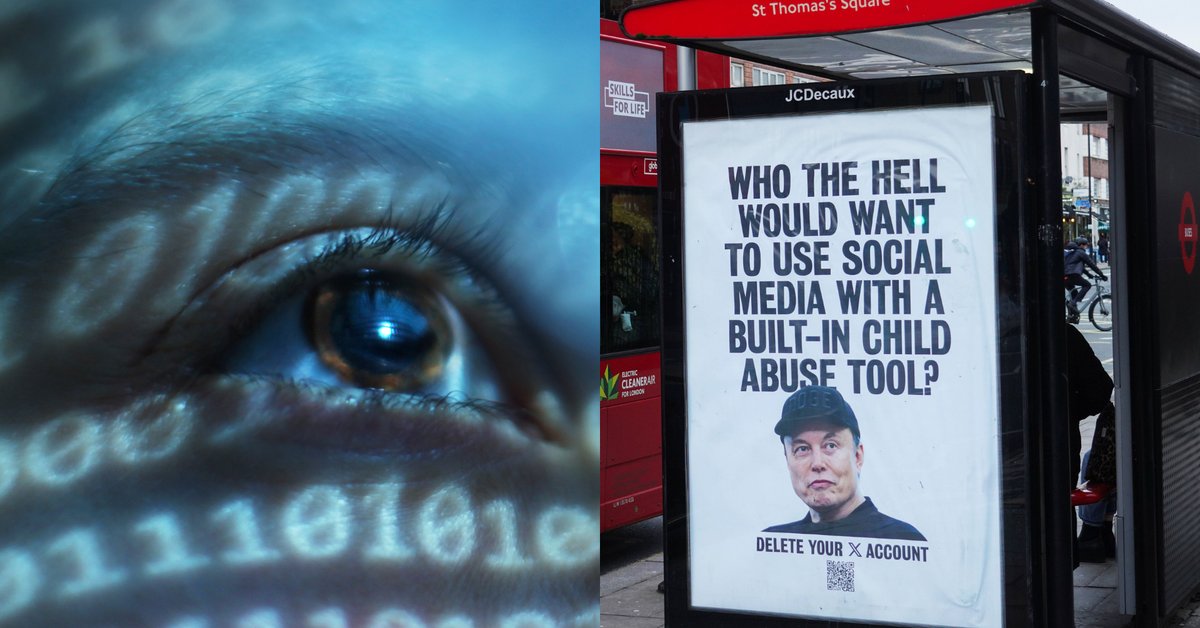

AI od Elona Muska „rozbiera” kobiety. Są narzędzia, by to zablokować

Wyedukowanie 99 proc. ludzkości nie sprawi, że pozostały procent będzie używał Groka do rozbierania 12-latek, co dzieje się obecnie na X.

No tak, akurat to jako branża technologiczna powinniśmy zablokować i moim zdaniem mamy do tego narzędzia. Reasumując to wszystko — myślę, że niedługo nadejdzie moment, w którym będzie musiała powstać światowa organizacja zajmująca się regulacją sztucznej inteligencji. Tak jak dziś na przykład są organy, które kontrolują, by kraje nie używały broni biologicznej. Z drugiej strony przerabianie zdjęć na treści pornograficzne powinno być od razu ścigane z urzędu przez każde państwo. Przecież algorytmy już dziś spokojnie mogą oznaczać takie zdjęcie i je po prostu usuwać — w dodatku, można np. wymusić, aby takie przeróbki mogły być możliwe tylko z kont zweryfikowanych, chyba właśnie X zaczął to robić.

W „OKO.press” pojawił się w grudniu artykuł o 15-letniej dziewczynce, której rówieśnicy przerobili zdjęcia na nagie i rozsyłali po szkole. Wezwana policja, a następnie prokuratura uznały, że są bezsilne, a wygenerowane zdjęcie nie łamie przepisów. Jesteśmy spóźnieni z przepisami regulującymi AI.

Tak, takie rzeczy muszą być ścigane. Uważam, że Unia Europejska w ramach wspólnoty powinna w każdym z krajów wybudować „Gigafactory AI” lub nakłonić państwa do inwestycji, a nie budować jakieś koalicje między krajami i cieszyć się z mikro projektów. Każdy kraj w Unii — jedna „Gigafactory AI” jako rdzenna infrastruktura o znaczeniu krytycznym w ramach obowiązków zajmująca się również regulacją i obroną obywateli przed skutkami używania sztucznej inteligencji. Bo to jest trend, który sam się nie cofnie. Warstwa infrastrukturalna, wspólna strategia i prawo muszą być dostarczone przez państwo i UE. Potwierdziła mnie w tym wizyta na tegorocznym Światowym Forum Ekonomicznym w Davos, gdzie uczestniczyłem w sporej części wydarzenia jako jedyny Polak. Napisałem od razu apel do premiera i prezydenta.

Apel Jarosława Królewskiego do Karola Nawrockiego i Donalda Tuska:

A czy nie powinniśmy zakazać politykom publikowania treści wygenerowanych przez AI? W ostatnich tygodniach nawet posłowie potrafią publikować materiały graficzne z przerobionymi Donaldem Tuskiem czy Karolem Nawrockim.

Jest jeden polityk z prawej strony, który regularnie generuje takie filmy, ale nie chcę się tu do niego odnosić, bo mój maltańczyk, który nie należy do szczególnie mądrych psów, ma iloraz inteligencji na podobnym poziomie. Ale zgadzam się, politycy powinni mieć wpisane w kodeks etyki sejmowej, by nie używali AI w taki sposób. To, że musimy mówić o posłach robiących takie rzeczy, już jest porażką nas jako Polaków.

W Synerise narzucacie sobie jakieś etyczne blokady?

Tak jak wspominałem, zajmujemy się nieco inną częścią branży niż modele językowe, ale działalność w branży technologicznej niesie za sobą dużą odpowiedzialność. Część naszych systemów i innowacji np. w zakresie zanurzania grafów udostępniamy jako otwarte oprogramowanie na przykład na rynku medycznym. Nie musimy też zastanawiać się nad etyką karmienia modeli cudzymi danymi, bo nasze innowacje to nowoczesna algorytmika, a nie własność danych.

Trendy AI na 2026 r. To się zmieni. „Rok przełomów”

Według badań opublikowanych w czasopiśmie naukowym Patterns AI zużywa tyle wody, co cała ludzkość razem wzięta. Czy jest możliwe, że w przyszłości przez zużywanie najcenniejszego surowca na ziemi zostanie ograniczone komercyjne wykorzystywanie AI?

Myślę, że prędzej te rozwiązania staną się płatne. Nie będzie już darmowych wersji na przykład Chata GPT czy Copilota w różnych wersjach. Aczkolwiek zużycie zasobów naturalnych ziemi to cena rozwoju cywilizacji.

Tylko węgiel zużywaliśmy do maszyn parowych, a wodę marnujemy, by zapytać asystenta AI o przepis na ciasto albo wykonać czynność, do której zwykła internetowa przeglądarka jest wystarczająca.

Tak, też zastanawiam się nad tym, ale jest taki eksperyment myślowy, według którego ten rozwój AI, który zużywa nam zasoby, pozwoli nam osiągnąć poziom cywilizacyjny, w którym będziemy mieli rozwiązania pozwalające odzyskać nam te materiały, mądrzej zarządzać złożami czy zastąpić paliwa kopalniane. Jeśli założymy, że AI jest nam w stanie w tym pomóc poprzez autonomiczne badania naukowe, o których wspominałem, to warto podjąć takie ryzyko. A używanie komercyjne tych modeli językowych przez ludzi do błahych spraw, sprawia, że one się uczą i rozwijają.

Prosty przykład — to, że tysiące ludzi zaczęło bawić się generowaniem twarzy czy ciała, spowodowało powstanie materiału naukowego, który był relewantny nie tylko dla „głupich” obrazków, ale również przyczynił się do rozwiązań wykrywających wady genetyczne i choroby w medycynie – czy ogólnie rozwój dziedziny computer vision. To trochę jak z Elonem Muskiem, który chce wysłać ludzi na Marsa. Zużyje przy tym wiele zasobów, ale przy okazji jego naukowcy dokonają wielu odkryć i stworzą nowe wynalazki.

Podsumowując to wszystko — pomijając najbogatszy promil społeczeństwa — czy sztuczna inteligencja ma dzisiaj więcej szans czy zagrożeń dla przeciętnego człowieka?

Sztuczna inteligencja to szansa dla tych, którzy byli dotychczas dyskryminowani i mieli mniejsze możliwości. Nie było ich stać na prawników, grafików czy programistów. Popularny w branży staje się zwrot „One-Person Unicorn”, czyli jednoosobowe firmy, które dzięki agentom sztucznej inteligencji redefiniują rynek biznesu.

Jaki będzie 2026 r. dla sztucznej inteligencji?

Myślę, że to będzie rok kolejnych przełomów i gdy zdzwonimy się za rok o tej porze, to rozmowa na temat dochodu gwarantowanego będzie jeszcze gorętsza. Będzie to moment przełomu i uświadomienia dla rządzących tym światem, że praktycznie każdy element rzeczywistości się zmienia.