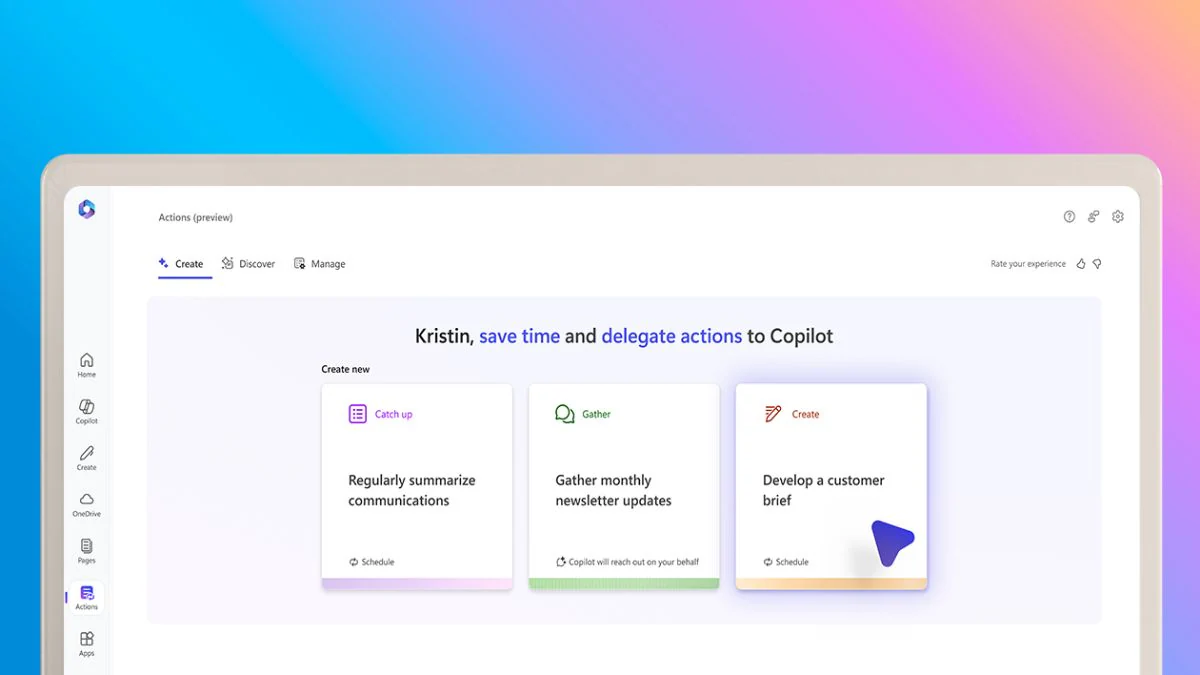

A Microsoft anunciou recentemente a implementação gradual do Copilot Actions no Windows 11. É um recurso experimental disponível para Windows Insiders que automatiza tarefas atribuindo um chatbot de inteligência artificial (IA) a ações cotidianas, como organizar arquivos ou enviar e-mails. A empresa, no entanto, citou novos riscos de segurança e recomendou que esta funcionalidade fosse utilizada apenas se os utilizadores compreendessem as suas implicações de segurança. Os especialistas já alertaram sobre as ações do Copilot, chamando os limites de segurança da Microsoft de “não realmente um limite”.

Aviso da Microsoft sobre ações do copiloto

Apesar de todas as capacidades da IA de agência, ainda existem limitações funcionais em termos de seu comportamento e tendência a alucinar e fornecer resultados inesperados, explicou a Microsoft em um comunicado. postagem no blog. Estes estão associados aos defeitos inerentes aos grandes modelos de linguagem (LLMs). Consequentemente, pode haver casos em que a IA distorce os factos e fornece respostas factualmente imprecisas e até bizarras.

Além disso, existem novos riscos de segurança associados às aplicações de IA de agentes. Por exemplo, a injeção de prompt cruzado (XPIA) pode resultar na incorporação de conteúdo malicioso em documentos e elementos da interface do usuário. Isso acarreta o risco de as instruções do agente serem substituídas, levando à exfiltração de dados, instalação de malware ou outras ações não intencionais.

A Microsoft disse que construiu proteções apropriadas para mitigar tais casos. Para começar, todas as ações automatizadas realizadas pelas ações do Copilot são observáveis e distinguíveis daquelas realizadas manualmente por um usuário. Além disso, os agentes de IA que coletam e utilizam dados protegidos dos usuários devem atender ou exceder os padrões de segurança e privacidade dos dados consumidos.

Por último, todos os pedidos de utilização de dados do utilizador, bem como as ações a tomar, serão aprovados pelo utilizador. A empresa esclareceu ainda que os administradores de TI podem desativar um espaço de trabalho de agente tanto no nível da conta quanto no nível do dispositivo para contas de espaço de trabalho, usando aplicativos de gerenciamento de dispositivos móveis (MDM).

Apesar dos esforços da empresa, o novo recurso Copilot Actions foi examinado por especialistas em segurança.

O que dizem os especialistas

Em um conversa com a ArsTechnica, o pesquisador de segurança independente Kevin Beaumont comparou o Copilot Actions com macros no Microsoft Office.

As macros, principalmente, são sequências de instruções que automatizam tarefas repetitivas, executando-as como um único comando. Embora a sua utilidade tenha sido explorada para poupar tempo e aumentar a eficiência, a empresa também alerta periodicamente sobre os riscos associados às macros, que podem ser usadas para executar código malicioso para roubar dados, transferir ficheiros ou instalar malware. Assim, a Microsoft desativa macros por padrão.

“A Microsoft dizendo ‘não habilite macros, elas são perigosas’… nunca funcionou bem. Estas são macros no super-herói da Marvel [drugs]”, alertou Beaumont.

Outra preocupação levantada pelos especialistas foram os desafios enfrentados pelos utilizadores experientes na detecção quando os agentes de IA estão a ser explorados por atacantes. Embora os objetivos de segurança da Microsoft tenham sido elogiados, a dependência de que os utilizadores leiam e aprovem os avisos de risco que aparecem nas janelas de diálogo também foi considerada motivo de preocupação, diminuindo potencialmente o valor geral da proteção.

“Às vezes, esses usuários não entendem completamente o que está acontecendo, ou podem simplesmente se habituar e clicar em ‘sim’ o tempo todo. Nesse ponto, o limite de segurança não é realmente um limite”, disse Earlence Fernandes, professor especializado em segurança de IA na Universidade da Califórnia, à publicação.

Enquanto isso, um especialista comparou o aviso de segurança da Microsoft à manobra legal da CYA, que visa simplesmente proteger a parte de possíveis responsabilidades. Eles alegaram que a Microsoft não tem nenhuma contingência para lidar com alucinações e injeção imediata, o que torna o Copilot Actions “fundamentalmente impróprio para quase tudo sério”.