För att försöka lugna de som oroar sig om integriteten och säkerheten i autonoma Gemini Intelligence har Google berättat hur användares data ska skyddas. Huruvida åtgärderna duger är upp till var och en att avgöra.

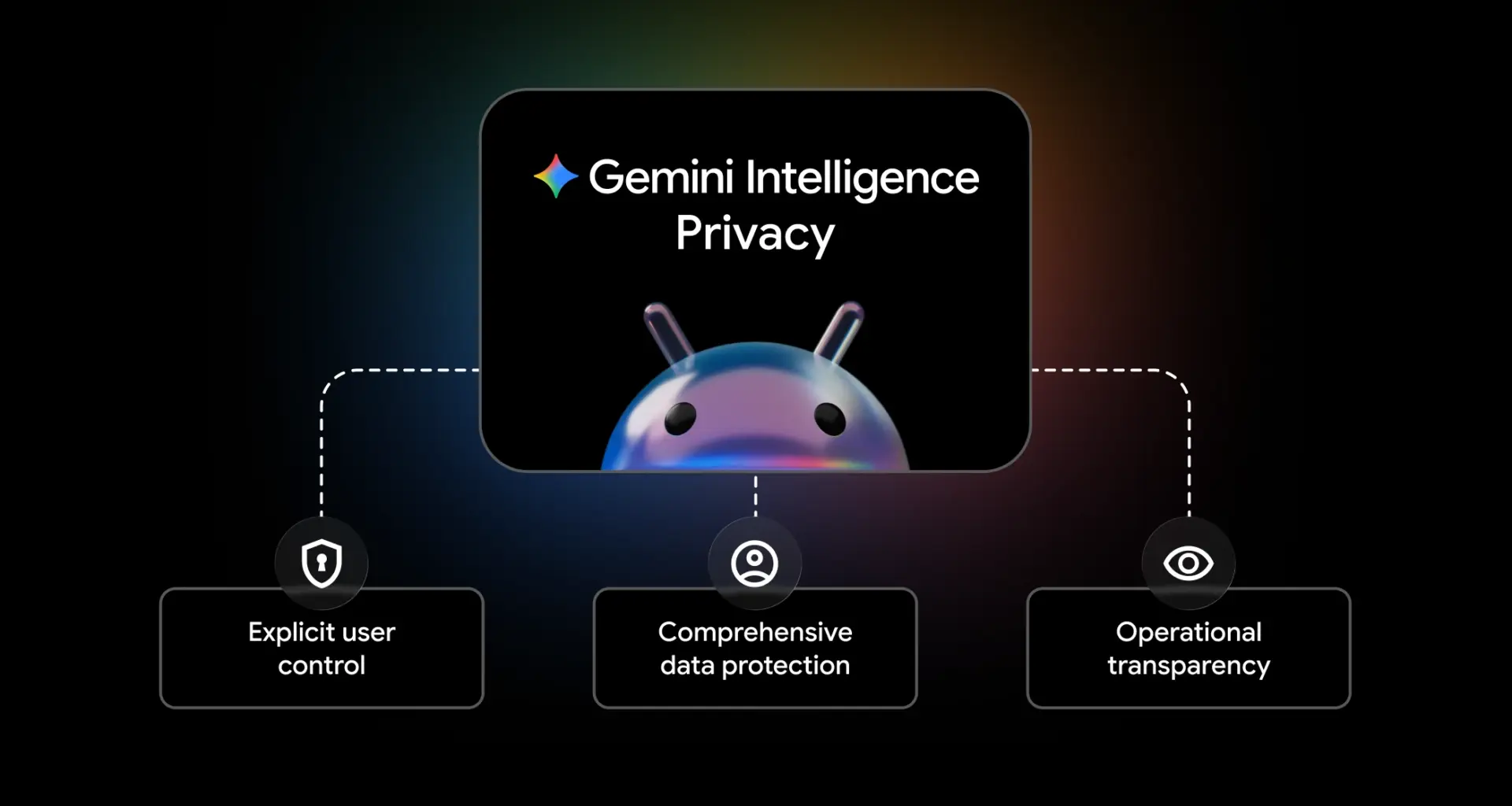

Enligt Google är Android på väg att gå från att vara ett operativsystem till att bli ett intelligenssystem. Techjätten skriver att ”fantastiska AI-upplevelser” kräver kompromisslös integritet. Gemini Intelligence har därför tre grundprinciper:

1. Uttalat godkännande av användaren

2. Omfattande dataskydd

3. Transparens kring vad som händer

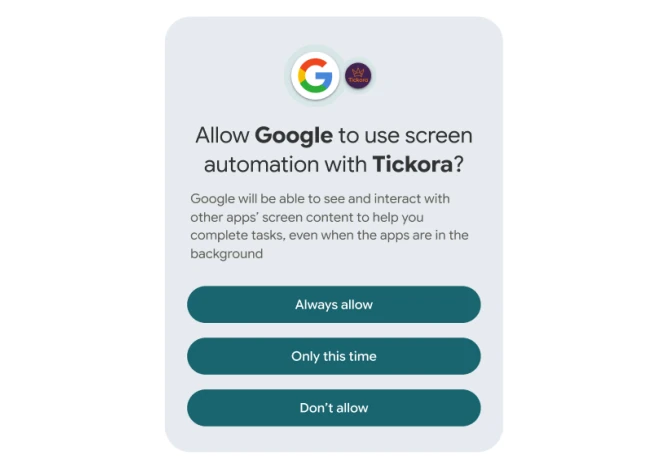

Enskilda funktioner som är del av Gemini Intelligence-sviten kan aktiveras eller stängas av separat. Gemini börjar automatisera uppgifter först efter att användaren bett om det, och Gemini får bara tillgång till de appar användaren tillåter assistenten att nå. Övriga enheten är onåbar för Gemini.

Användare ska även kunna styra andra aspekter av vad som delas med Gemini, likt skärminnehållet. Data som behandlas av proaktiva finesser skyddas av Private Compute Core, Private AI Compute, samt något kallat ”skyddad KVM” som först introducerades förra sommaren. Systemet har skydd mot prompt-injicering – det vill säga när en angripande utomstående part försöker skjuta in en lömsk instruktion till Gemini utan att användaren vet om det.

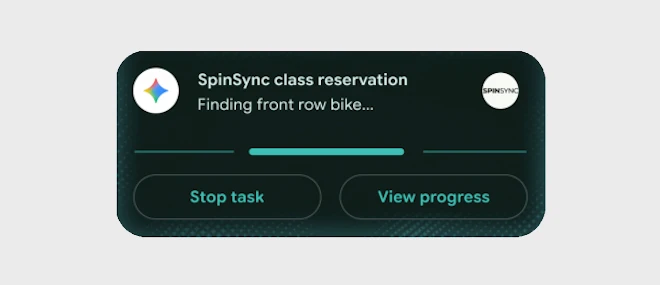

Angående transparensen: När Gemini Intelligence arbetar med en uppgift går assistentens framsteg att följa live. Det ska gå att se precis vad Gemini gör för tillfället. Live-aviseringen kan inte avfärdas, så det framgår alltid när Gemini jobbar med något i bakgrunden. Androids integritetsöversikt (privacy dashboard) kommer visa vilka AI-assistenter som varit aktiva och vilka appar de använt de senaste 24 timmarna.

Viktiga delar av Googles säkerhetsarkitektur har enligt tillkännagivandet öppen källkod och granskas av oberoende experter. Målet är att göra Android till en öppen plattform där utvecklare och tillverkare kan skapa ”unika och pålitliga agentiska upplevelser”